Subscribe to Bankless or sign in

Vor ein paar Monaten, postete RSA über die Vorstellung eines ein Plug-and-Play-Gerät vorzustellen, mit dem Nutzer private, persönliche Daten mit jedem LLM ihrer Wahl nutzen könnten - im Grunde ein Ledger für KI. Eine schlüsselfertige Hardwarelösung, auf der lokale Modelle laufen, die von führenden KI-Tools wie eine Cloud behandelt werden könnten, die dieselbe Benutzeroberfläche bietet, aber mit "kugelsicherem Datenschutz".

Randbemerkung: Wenn Sie noch einmal wissen möchten, warum der Datenschutz in der KI absolut entscheidend ist, sollten Sie sich diese drei Punkte vor Augen führen, die ich immer wieder betont habe:

- Unverschlüsselt während der Nutzung - Daten sind genau dann am verwundbarsten, wenn sie am sensibelsten sind, wenn KI unsere Geschäftsstrategien, Gesundheitsprobleme und persönlichen Probleme verarbeitet.

- Massiver Anreiz zur Ausbeutung - Auch wenn die aktuellen Richtlinien den Schutz der Privatsphäre versprechen, haben Unternehmen allen Grund, diese zu ändern und Ihre Daten als Wettbewerbsvorteil zu nutzen, was das Leckpotenzial vervielfacht.

- Heimtückische Rückkopplungsschleifen - Das Training, das mit unseren intimsten Gedankenmustern durchgeführt werden kann, erweist sich als erschreckend, wenn man es mit dem gewinnorientierten Charakter dieser Unternehmen in Verbindung bringt, was zu Visionen von (zumindest) hyperprädatorischen sozialen Feeds führt, die durch KI aufgeladen werden. Ich möchte hier nicht das "Schlimmste" in Betracht ziehen

In den letzten Wochen habe ich über verschiedene "private KI"-Lösungen berichtet - von Venedig bis NilGPT - behandelt, die alle einen Durchbruch in Sachen Datenschutz versprechen, bleiben sie jedoch hinter dieser umfassenden Vision für ein gleiches Leistungsniveau zurück. Eine Vision, die sich meiner Meinung nach in nicht allzu ferner Zukunft verwirklichen wird.

Zu diesem Zweck hat letzte Woche das Flaggschiff der experimentellen KI-Organisation von Ethereum, Freysa, ihre Enchanted Mobile App veröffentlichtveröffentlicht, die zwei Ansätze für private KI auf Ihrem Handy bietet:

- Open-Source-Modelle wie DeepSeek R1 und Llama 3.3 70B, die in vertrauenswürdigen Ausführungsumgebungen (TEEs) laufen

- Closed-Source-Modelle mit privatem Zugriff durch mehrschichtige Anonymisierung

Diese Closed-Source-Datenschutzlösung unterscheidet Enchanted von anderen Anwendungen, über die ich kürzlich berichtet habe. Während Venice und NilGPT auf Open-Source-Modelle zurückgreifen, die bei der Leistung hinter den Closed-Source-Modellen zurückbleiben, ermöglicht der Anonymisierungsansatz von Freysa den Nutzern das Beste aus beiden Welten, indem er eine Lösung bietet, die sowohl Datenschutz als auch Leistung bietet.

Das Team hat in"Reinforcement Learning for Privacy" detailliert beschrieben, wie sie dies erreichen, indem sie ein Zwei-Modell-System verwenden, das mit speziell trainierten kleinen Sprachmodellen (SLMs) ausgestattet ist, die im Namen der Nutzer anonymisierte Anfragen an führende Closed-Source-LLMs (OpenAI, Claude usw.) stellen.

Es funktioniert folgendermaßen:

- Ich sende eine Abfrage mit sensiblen Informationen an das SLM von Freysa, das entweder aus der Ferne (in der Enchanted-App) oder lokal auf meinem Computer läuft (technische Kenntnisse erforderlich).

- Dieses Modell ersetzt meine sensiblen Daten - Bankkonten, berufliche Positionen usw. - durch semantisch äquivalente Platzhalterwörter, die die Bedeutung und Absicht des Satzes beibehalten.

- Diese bereinigte Eingabeaufforderung wird zur Verarbeitung an eine Closed-Source-KI meiner Wahl gesendet.

- Die Antwort kehrt an das lokale Modell zurück, das sie "entschlüsselt" und so die Qualität eines geschlossenen Modells bei intakter Privatsphäre liefert.

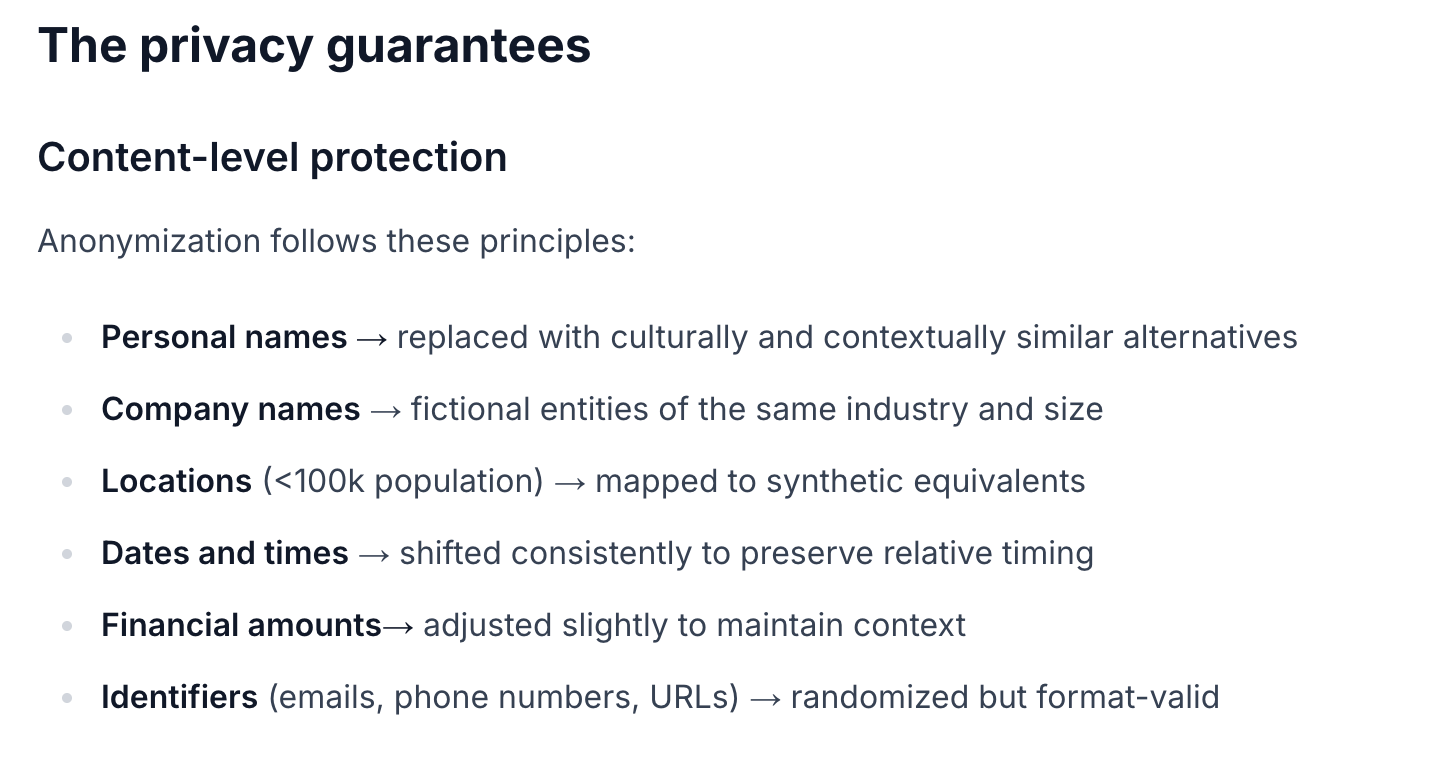

Das Modell von Freysa folgt bestimmten Grundsätzen, um zwischen privaten und öffentlichen Informationen zu unterscheiden, und anonymisiert gemäß diesen Richtlinien:

Es besteht zwar das Risiko, dass das Freysa-System private Informationen mit öffentlichen verwechselt (oder umgekehrt), aber das Team ist zuversichtlich, dass sein Modell in der Lage ist, zwischen den beiden zu unterscheiden, und verweist auf die Tatsache, dass

- LLMs schneiden bei Anonymisierungsaufgaben bereits außergewöhnlich gut ab

- Bei einem Vergleich mit dem Anonymisierungsergebnis von GPT-4.1 von 9,77/10 erreicht ihr Modell bis zu 9,55/10, was bemerkenswert nahe dran ist, obwohl es etwa 1000x kleiner ist.

Über den durch die Anonymisierung erreichten Schutz der Privatsphäre hinaus implementiert Freysa Sicherheitsvorkehrungen auf Netzwerkebene über TEEs und Verkehrsverschleierung, um Außenstehende davon abzuhalten, die Anonymität ihres Systems durch die Verfolgung von Nutzungsmustern zu "knacken". Das Team beschreibt das Endergebnis als Eingabeaufforderungen, dieals anonyme Anfragen von verschiedenen 'Personen' erscheinen" - und so die einzelnen Benutzer innerhalb einer Menge effektiv maskieren.

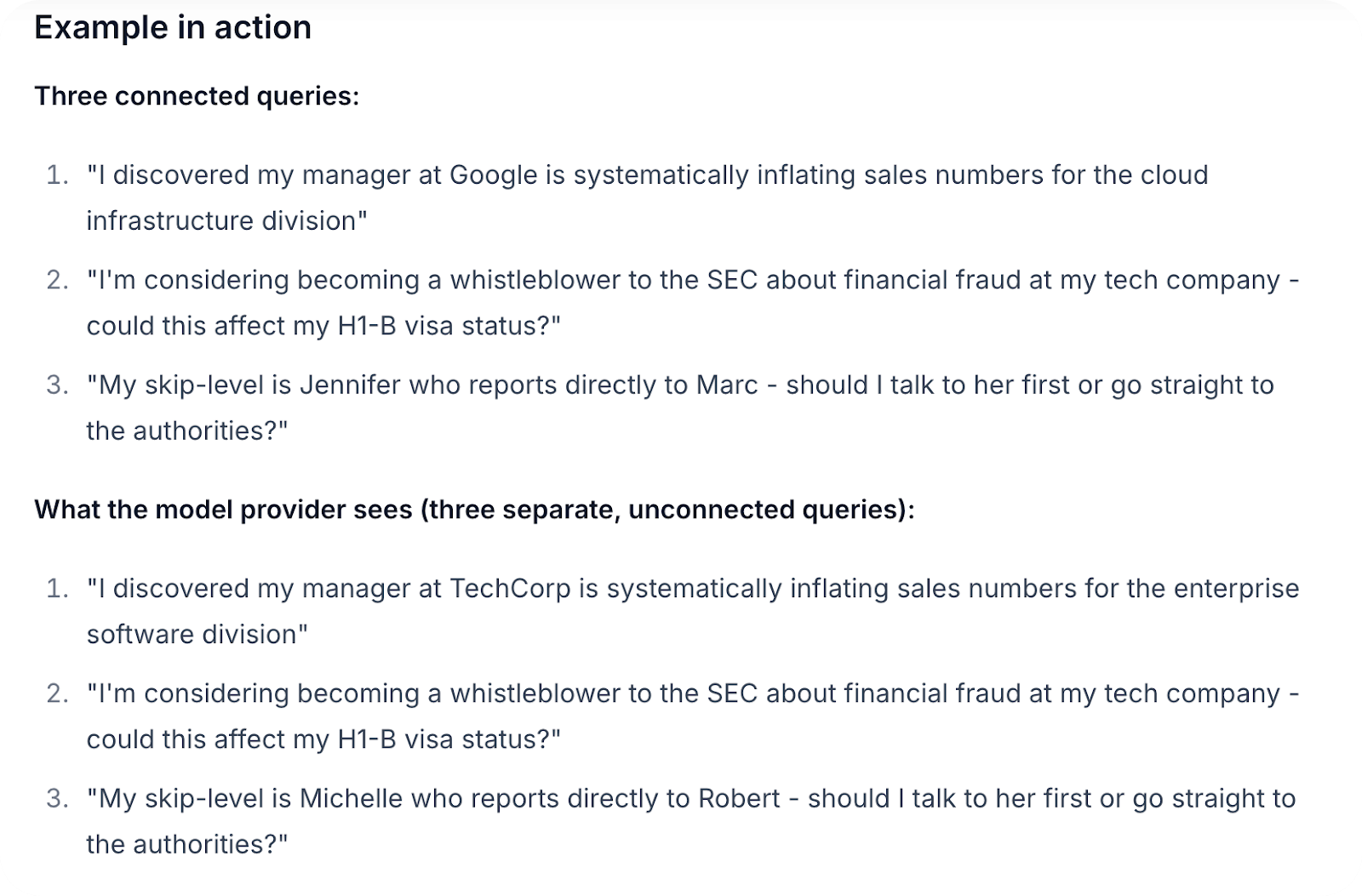

Aber nichts ist perfekt. Nach der Lektüre ihres Blogs hatte ich den Eindruck, dass die beschriebenen Beispielanfragen von den Unternehmen hinter den Closed-Source-Modellen möglicherweise "entschlüsselt" werden könnten, da die Abfragen einen klaren roten Faden bilden (siehe Beispiel unten).

Dies sind die derzeitigen Einschränkungen, die Freysa einräumt, indem es klarstellt, dass:

- Nutzer mit sehr einzigartigem Satzbau oder Abfragemustern könnten möglicherweise identifiziert werden.

- Die Stärke des Netzwerkschutzes hängt von der Verfügbarkeit des Relais-Netzwerks oder der TEE-Implementierung ab.

- Die Nutzer müssen weiterhin darauf vertrauen, dass das Freysa-System wie vorgesehen funktioniert.

Das Team hat auch mitgeteilt, was was als nächstes für Enchanted kommt:

- Unterstützung für multimodale Modelle (solche, die Bilder, Audio und Text verarbeiten können)

- Intelligentes Routing-System, das automatisch das beste KI-Modell für die jeweilige Anfrage auswählt

- Verbesserung des Anonymisierungsmodells, so dass es klein genug ist, um direkt auf Ihrem Telefon zu laufen, was bedeutet, dass sensible Daten Ihr Gerät gar nicht erst verlassen, auch nicht in anonymisierter Form

Trotz dieser Vorbehalte hebt sich das System von Freysa als eine einzigartige Methode hervor, um das Spannungsverhältnis zwischen Datenschutz und Leistung zu überwinden, und stellt einen wichtigen Schritt bei der Erweiterung des Potenzials für private KI dar.

Angesichts des Open-Source-Charakters von Kryptowährungen und des Wertesystems der Souveränität, auf dem dieser Bereich aufgebaut wurde, macht es Sinn, dass die Zukunft der privaten KI aus unserer Branche kommt. Auch wenn das aktuelle Modell von Freysa nicht genau das "Ledger für KI" ist, das wir uns vorstellen, so ist es doch ein sinnvoller Schritt, um den Datenschutz in die Technologien zu integrieren, die wir täglich nutzen - das ist immer sauberer, als eine neue Technologie in den Mix zu bringen.

Wenn Sie dieses System selbst testen möchten, probieren Sie Enchanted oder ihre Modelle von Hugging Face für Entwickler, die eine tiefere Integration anstreben - letzteres eine Entscheidung, die sicherlich zum Wachstum der privaten KI insgesamt beitragen wird.